生成AIの著作権問題とは?基本の3つの論点をわかりやすく解説

画像や文章を数秒で生み出す生成AI。しかしその裏側では、「これは誰かの権利を侵害していないか?」という著作権問題が常に潜んでいます。この複雑な問題を解き明かす鍵は、問題を3つのフェーズに分解して捉えることです。AIがデータを「入力」する学習段階、コンテンツを「出力」する生成段階、そして私たちがそれを「利用」する段階──。それぞれの段階でどのような法的論点が存在するのか、基本からわかりやすく解説します。

AIは著作物を無断学習?「入力段階」の著作権問題

生成AIが驚異的な能力を持つ根源は、インターネット上の膨大なテキストや画像を「学習」することにあります。しかし、そのデータに著作物が無断で含まれているのではないか、という点が「入力段階」における最大の問題です。日本の著作権法第30条の4では、AI開発のような情報解析が目的の場合、原則として著作権者の許諾なく学習が認められています。

しかし、これには「著作権者の利益を不当に害する場合」という例外規定が存在し、この解釈が現在の議論の中心です。例えば、学習用に販売されているデータを無断で利用する行為は、これに該当する可能性が高いとされています。このリスクを背景に、クリエイター団体からは学習データの利用に事前許諾を求める「オプトイン」方式の要求が高まっています。企業にとっては、Adobe社の「Firefly」のように学習データの出所が明確でクリーンなAIサービスを選定することが、重要なリスクヘッジ戦略となりつつあります。

AIは作者になれない?「出力段階」での権利の所在

AIが自動で生み出した作品。その著作権は一体誰のものでしょうか。結論から言えば、現在の法解釈ではAI自体が著作者になることはありません。著作権は人間の「思想又は感情」を創作的に表現したものに与えられるため、2026年3月には米最高裁も「著作者は人間」という判断を事実上確定させています。

しかし、AI生成物すべてに権利が発生しないわけではありません。人間による「創作的寄与」が認められれば、その人間が著作者となり得ます。実際に2025年11月、国内で初めてAI生成画像の著作物性を認めて無断複製が摘発された事例は、この点を明確に示しました。結局AIは「道具」であり、なぜあなたの指示は伝わらないかを深く理解し、プロンプトや修正プロセスに独自の工夫を凝らすことで、初めてあなたの著作物として保護されるのです。そのため、生成過程の記録を残すことが、今後のリスク管理において極めて重要になります。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

意図せず著作権侵害?「利用段階」で問われる責任

AIが生み出したコンテンツを公開・販売する「利用段階」では、責任の所在がAI開発者からユーザー自身へと移ります。万が一、生成物が第三者の著作権を侵害していた場合、「知らなかった」では済まされず、その責任を負うのは利用者です。著作権侵害は、既存の作品との「類似性」と、それを元に創作した「依拠性」で判断されますが、AIは学習データに基づき生成するため、ユーザーが意図せずとも依拠性が認められるリスクを常に内包しています。特に、Web情報を参照するRAG(検索拡張生成)では参照元が明確なため、生成物が無断転載とならないよう利用者は厳重な確認義務を負うと指摘されています。こうしたリスクに備え、万一の際に自社の正当性を主張できるよう、「なぜあなたの指示は伝わらない」のかも含め、プロンプトや修正過程を記録・保存することがリスク管理の観点から強く推奨されています。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

生成AIと著作権を巡る現状とクリエイターが直面する課題

基本的な論点を押さえた上で、次に目を向けるべきは、世界で今まさに起きている具体的な動きです。2026年、米最高裁が「AIは作者ではない」という歴史的な司法判断を下す一方、技術の世界ではコンテンツの出自を証明するC2PAが標準化しつつあります。さらに、AIによる模倣から自作を守るIP監視という新たな潮流も生まれました。ルールと技術が激しくせめぎ合う今、クリエイターが直面するリアルな課題と、その最前線を紐解いていきましょう。

AIは作者ではない、米最高裁が下した歴史的な司法判断

2026年3月、生成AIの著作権史に刻まれるべき画期的な判断が下されました。米最高裁判所は、AIが生成した作品の著作者をAI自身と認めるよう求めた訴えを退け、「著作者は人間でなければならない」という原則を事実上確定させたのです。これは、AI単独の生成物には著作権が発生しないことを意味し、AIはあくまで「道具」であるという位置づけを司法が明確にした歴史的瞬間でした。この判断は、クリエイターに新たな問いを投げかけます。AIの出力に、人間としてどれだけの「創作的寄与」を加えられるか。まさになぜあなたの指示は伝わらないか、その技術とアイデアこそが、自らの権利と作品を守る鍵となる時代が到来したと言えるでしょう。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

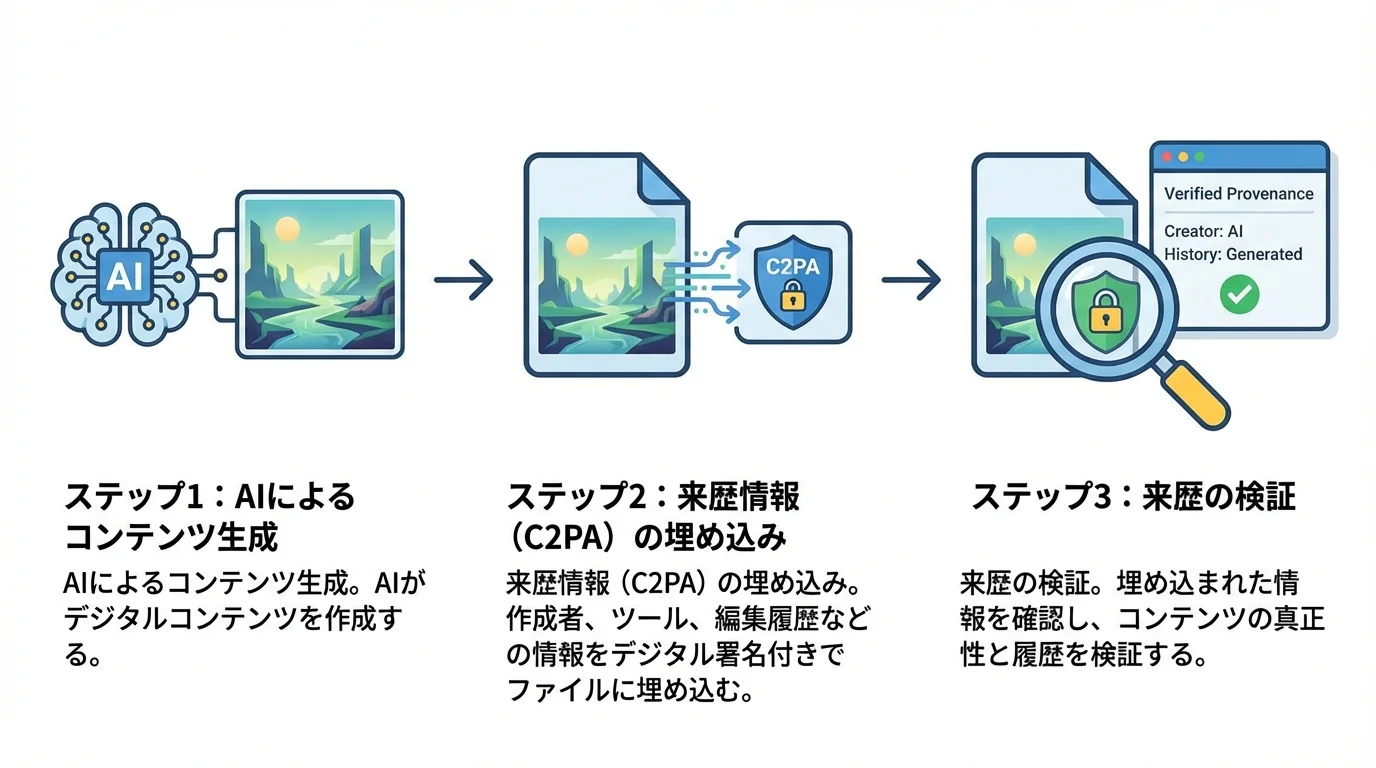

クリエイターの作品を守る?C2PAによる来歴証明の現実

AI生成コンテンツが氾濫する中、その出所を証明する技術として「C2PA」が注目されています。これはAdobeやMicrosoftなどが推進する規格で、ファイルに「AI製である」という電子証明書(コンテンツクレデンシャル)を埋め込み、来歴証明を可能にするものです。これにより、フェイクニュース対策や透明性の確保が期待されています。しかし、これがクリエイター保護の万能薬かと言えば、現実は異なります。C2PAが証明するのは「AIが生成した」という事実までであり、その生成物が誰かの著作権を侵害しているかまでは判断しません。結局、技術による証明は重要な一歩ですが、真の権利保護には学習データの透明性確保など、より根本的な議論が不可欠なのです。私たちは生成AIとは何かという問いと共に、技術の社会的実装を考え続ける必要があります。

あわせて読みたい

生成 ai とはについて、導入方法から活用事例まで詳しく解説します。

模倣から自作を守る、AIを活用したIP監視という新潮流

生成AIによるコンテンツの氾濫は、クリエイターの作品が意図せず模倣されるリスクを増大させました。人間の目だけで広大なインターネットの海を監視し、権利侵害を発見することは、もはや限界に達しています。この課題に対し、「AIをもってAIを制す」という新しい潮流が生まれています。その象徴が、AIを活用した次世代型IP監視サービスです。2026年に検証が始まった「IP PATROL(仮称)」のように、SNSや動画サイトをAIが自動で巡回し、キャラクターやロゴの不正利用をリアルタイムで検知する技術が注目されています。これは、企業が生成AI導入で得られるメリットとは、単なる業務効率化に留まらないことを示唆しています。こうした監視技術は、クリエイターが安心して創作に打ち込める環境を守るための、強力なデジタル上の盾となりつつあるのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

なぜ今「生成AIと著作権」が重要なのか?技術進化とビジネスリスクの背景

生成AIがビジネスに不可欠な存在となる一方、その著作権問題はもはや対岸の火事ではありません。コンテンツの来歴を証明するC2PAのような技術が標準化され、透明性が高まるほど、企業の利用責任は厳しく問われます。「知らなかった」では済まないこの問題が、なぜ今、事業の根幹を揺るがすリスクとなり得るのか。その背景にある技術進化と、変化し続けるルールがビジネスに与える影響を深掘りします。

技術進化が促す透明性、C2PA標準化が不可欠な理由

生成AIコンテンツが社会に浸透した結果、その出自が不明確であること自体がビジネス上の深刻なリスクとなっています。この課題に対する技術的な回答が、コンテンツの来歴と真正性を証明する国際標準「C2PA」です。Adobe、Microsoft、OpenAIといった主要企業が推進し、生成された画像などに「いつ、どのAIで作られたか」という情報を自動的に埋め込む動きが加速しています。これは、企業が意図せず著作権侵害コンテンツやフェイク情報を拡散してしまう事態を防ぐための防衛策となります。EUのAI法が求める透明性の義務化も追い風となり、C2PAはもはや単なる技術の一つではなく、なぜ今AI時代の信頼を担保するために不可欠な社会インフラとなりつつあるのです。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

「知らなかった」では済まない、問われる企業の利用責任

生成AIが作成したコンテンツで著作権侵害が発生した場合、その法的責任はAI開発企業ではなく、原則として「利用者」自身が負うことになります。「AIが自動で生成したから知らなかった」という主張は通用しません。文化庁の見解では、利用者が元の著作物を知らなくても、AIが学習データとして参照していれば「依拠性」が認められる可能性があるとされています。

このリスクに備え、企業は生成プロセスの記録を徹底すべきです。どのような指示で何を生成したかのログは、万一の際に「特定の著作物を模倣する意図はなかった」と証明する重要な証拠となります。特に、外部情報を参照するRAG(検索拡張生成)は、参照元からの無断転載と判断される危険性が高く、利用者側の監視義務がより厳しく問われます。もはや重要なのは利用の禁止ではなく、社内ガイドライン策定や学習データが透明なツールの選定といった、リスクを管理下に置くガバナンス体制の構築なのです。

ルール形成の過渡期、今こそ知るべきビジネスへの影響

2026年現在、生成AIの著作権ルールはまさに形成途上にあり、この不確実性がビジネスの現場に直接的な影響を及ぼしています。もはやツールの機能性だけでサービスを選ぶ時代は終わりました。今、企業に求められるのは、万一の訴訟リスクに備え、AIへの指示(プロンプト)や生成過程のログを保存し、自社の正当性を証明できる証拠を確保しておくことです。どのような指示で生成したかを記録することは、なぜあなたの指示は伝わらないかを分析するだけでなく、法的な防御策にもなるのです。さらに、Adobe Fireflyのように学習データの透明性を担保するツールを選定することは、積極的なリスクヘッジとなります。この過渡期を乗り切るには、ルールを正しく理解し、ガバナンス体制を構築した企業こそが競争優位性を築くことができるでしょう。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

【2026年最新動向】C2PA標準化と企業のガバナンス強化が新たな潮流に

生成AIを巡る著作権の議論は、2026年、ついに抽象的なリスク論から具体的な「実践」のフェーズへと移行しました。その象徴が、コンテンツの来歴を証明するC2PAの標準搭載です。これはもはや一部の先進的な取り組みではなく、社会インフラとしての「新常識」になりつつあります。この動きに呼応するように、企業の姿勢も単なる「利用禁止」から、リスクを管理し事業成長に繋げる「攻めのAIガバナンス」へと大きく転換しています。技術とルールが両輪となった今、企業に問われる真のコンテンツ管理責任とは何でしょうか。

C2PAの標準搭載が加速、コンテンツの来歴証明が新常識に

2026年、生成AIを巡る著作権の議論は、コンテンツの来歴を証明する技術標準「C2PA」の普及により新たな局面を迎えました。これはもはや一部の先進的な取り組みではなく、MicrosoftのBing Image CreatorやOpenAIのDALL·E 3といった主要サービスにおいて、生成物に来歴情報を記録した「コンテンツクレデンシャル」が自動的に付与されるのが標準仕様となりつつあります。

このメタデータにより、誰でも専用サイトでそのコンテンツがいつ、どのAIで生成されたかを検証可能になりました。フェイクニュース対策としての期待はもちろん、企業にとってはAI利用の透明性を担保し、説明責任を果たすための重要な証跡となります。例えば、ChatGPT画像生成で作成した広告素材も、その出自を明確にできるのです。コンテンツに来歴証明があることが「当たり前」となるこの変化は、クリエイターと企業の双方に、これまで以上に誠実な情報発信を求める新常識と言えるでしょう。

あわせて読みたい

ChatGPT 画像生成 ビジネスについて、導入方法から活用事例まで詳しく解説します。

禁止から管理・活用へ、攻めのAIガバナンスが企業の急務に

C2PAによる透明性確保が進む2026年、生成AIの利用を単に禁止する旧来の守りの姿勢は、ビジネス上の機会損失でしかありません。今、企業に求められるのは、著作権リスクを直視し、管理下で積極的に活用する「攻めのAIガバナンス」の構築です。具体的には、万一の際に自社の正当性(依拠性の否定など)を証明するため、プロンプトや修正過程のログを保存する体制が不可欠です。また、RAG(検索拡張生成)のように参照元が明確な技術では、無断転載を防ぐ監視義務も生じます。学習データがクリーンなツールを戦略的に選ぶことも含め、こうした実践的な管理こそが、企業が生成AI導入で得られるメリットとは何かを最大化する鍵となるでしょう。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

技術とルールが両輪に、問われる企業のコンテンツ管理責任

C2PAのような技術標準がコンテンツの透明性を担保する一方で、企業の責任はより実践的な管理体制の構築へとシフトしています。特に、Web情報を参照して回答を生成するRAG(検索拡張生成)のような新技術は、利便性の裏側で新たなリスクを生み出します。参照元が明確であるため「依拠性」が極めて認められやすく、生成物が無断転載とならないよう監視・修正する責任は、AI開発者ではなく利用する企業自身が負うことになるのです。

このような技術的リスクに対応するため、万一の訴訟時に自社の正当性を示す「ルール」の整備が不可欠です。具体的には、AIへの指示や修正過程をログとして保存する生成プロセスの記録が、企業の防衛策として強く推奨されています。どのようななぜあなたの指示は伝わらないかを含め記録することで、「模倣の意図はなかった」という主張の客観的な証拠となり得ます。技術の進化を的確に捉え、それを管理する社内ルールを構築する。この両輪を回して初めて、企業は生成物に対する説明責任を果たせるのです。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

生成AIと著作権の未来予測 - 米最高裁の判断が切り拓くクリエイションの形

2026年、ついに米最高裁が「著作者は人間である」との判断を確定させました。この歴史的な司法判断は、AIを「作者」ではなく、あくまで人間の創造性を拡張するための強力な道具と位置づけます。では、この原則が社会の共通認識となった未来において、私たちのクリエイションはどのような形へと進化していくのでしょうか。AIとの共存が前提となる世界で、人間の創造性が真に輝く未来の姿を予測します。

「AIは道具」、司法判断が拓く人間の創造性が輝く未来

2026年の米最高裁の判断は、AIを「作者」の座から降ろし、人間の創造性を拡張する「道具」として明確に位置づけました。この決定は、クリエイターの役割を根底から変えるものです。これからの創作活動では、単に完成した生成物だけでなく、そこに到達するまでの創作的寄与をいかに証明するかが重要になります。具体的には、AIへの指示(プロンプト)や生成後の修正過程といった「生成プロセスの記録」を保存することが、自らの独創性を主張する上での強力な武器となるでしょう。もはや、なぜあなたの指示は伝わらないのかを試行錯誤するプロセス自体が、著作物性の源泉となるのです。AIという強力な筆を手にした今、人間の創造性は「描く」行為から「いかに描かせるか」というディレクションの領域へと、その輝きを放つ舞台を移し始めています。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

「作者は人間」の原則が導く、来歴証明が必須となる未来

2026年の米最高裁の判断により「作者は人間」という法的な大原則が確立された今、クリエイションの価値は「何が作られたか」だけでなく「いかに作られたか」へとシフトしています。AIが作者と認められない以上、著作権の根拠は人間による「創作的寄与」にしかありません。この寄与を証明するため、コンテンツの来歴、すなわち制作プロセスの透明化が不可欠となるのです。具体的には、C2PAのような来歴証明技術が標準となり、なぜあなたの指示は伝わらないのかを突き詰めるような試行錯誤のログ自体が、創造性の証拠として価値を持つ時代が到来します。自らの創作プロセスを記録し、証明する意識こそが、AI時代の権利保護における新たな生命線となるでしょう。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

創造性の拡張か権利侵害か、問われるAIとの共存モデル

2026年、AIは創造性を飛躍させる「魔法の杖」であると同時に、他者の権利を踏み荒らす「凶器」にもなり得るという現実が鮮明になりました。クリエイター側は出版ネッツの声明のように公正な収益還元を求め、技術側はIP監視サービスで防衛線を張るなど、両者の緊張関係の中から新たな共存モデルが生まれつつあります。しかし、RAG(検索拡張生成)が参照元を無断転載するリスクを示すように、技術の進化は常に新たな火種を生みます。最終的に、侵害を避けるためのリテラシー、つまりなぜあなたの指示は伝わらないかを理解しAIを制御する能力こそが、クリエイターがこの新時代を生き抜く鍵となるでしょう。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

クリエイターと企業が取るべき著作権リスク対策 - プロンプト記録とガイドライン策定のすすめ

生成AIを巡る著作権のリスクや未来像が明らかになった今、問われるのは「では、具体的にどう行動するのか」という実践的な視点です。理論武装だけでは、意図せぬ権利侵害から自らを守ることはできません。本章では、守りの要となる社内ガイドラインの策定から、万一の際に「人間の創作」を証明する武器となるプロンプトの記録まで、明日から実践できる具体的な防御策を徹底解説します。あなたの創造性とビジネスを、法的なリスクから守り抜くための実践知がここにあります。

守りの第一歩、著作権侵害を防ぐ社内ガイドライン策定術

生成AIの利用を単に禁止するだけでは、ビジネスチャンスを逸してしまいます。今求められるのは、リスクを管理下に置き活用するガバナンスの視点であり、その第一歩が実効性のある社内ガイドラインです。策定にあたっては、①学習データがクリーンなツールの選定、②機密情報や特定の作家名などを含むプロンプトの禁止、③生成物の公開前チェックフローの確立、といった項目は必須です。特に、いつ誰がどんな指示で生成したかという生成プロセスの記録は、万一の際に「依拠性」を否定する重要な証拠となり得ます。こうしたルールは一度作って終わりではなく、EUのAI法などの動向も踏まえ継続的に見直すことで、企業が生成AI導入で得られるメリットとはを安全に追求できるのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

「人間の創作」を証明する、プロンプト記録という新常識

AIが生成した成果物に著作権は認められるのか。この問いの答えは、そこに「人間の創作的寄与」があったかどうかで決まります。しかし、その「寄与」は目に見えません。そこで不可欠となるのが、AIへの指示、すなわちプロンプトの全履歴を記録・保存するという新常識です。これは単なる備忘録ではありません。どのような狙いで指示を出し、生成された結果をどう評価し、修正を重ねて最終的なアウトプットに至ったのか。この一連の試行錯誤のログこそが、あなたの思想や感情が創作的に表現された過程を証明する、唯一無二の証拠となります。優れたアウトプットを追求する中で、なぜあなたの指示は伝わらないのかを突き詰めるプロセス自体が、重要な創作活動なのです。2026年現在、プロンプト記録は権利侵害を否定する防御策としてだけでなく、自らのクリエイティビティを法的に主張するための攻めの戦略として、すべてのクリエイターが実践すべき必須スキルとなっています。

あわせて読みたい

生成 ai プロンプトについて、導入方法から活用事例まで詳しく解説します。

自社の権利を守り抜く、AIによるIP監視サービスの活用法

生成AIによるコンテンツの氾濫は、自社のキャラクターやロゴが無断で模倣されるリスクを飛躍的に高めました。人間の目では追いきれない膨大なコンテンツの海から、権利侵害の芽を見つけ出すことはもはや不可能です。そこで新たな防衛策として浮上しているのが、AIを活用したIP監視サービスです。例えば、2026年に登場した「IP PATROL」のような次世代型サービスは、SNSや動画サイトをAIが自動で巡回し、自社の知的財産の不適切な利用を検知します。これは、単なる事後対応ではなく、ブランド価値の毀損を早期に発見し、知的財産を守り抜くための戦略的投資です。企業が生成AI導入で得られるメリットとは、こうした守りの活用にも表れているのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

生成AI著作権保護の限界と異なる見解 - 技術標準や法規制は万能か?

C2PAによる来歴証明、企業のガバナンス強化――。これまでの章で、生成AIの著作権リスクに対する「処方箋」を提示してきた。だが、果たしてそれらは万能薬だろうか?技術は常に法の抜け穴を探し、C2PAのような仕組みも悪意の前では脆い。本章では、こうした技術標準や法規制が抱える構造的な限界と、専門家ですら意見が割れる終わらない議論の現実に、あえて踏み込んでいく。

技術標準は万能ではない?C2PAの普及と残された課題

コンテンツの「パスポート」ともてはやされるC2PAだが、これを万能薬と信じるのは危険な幻想に過ぎない。確かに、生成AIによるものか否かを示す来歴証明は透明性向上の一歩だ。しかし、C2PAはあくまで「誰が何で作ったか」を示すだけで、その生成物が著作権を侵害した「盗品」かどうかは判定しない。悪意のある者がこの証明を意図的に削除・改変する抜け道も残り、そもそも標準に準拠しない無法なAIツールには無力である。技術による証明は、あくまで紳士協定の域を出ず、結局は法的整備や利用者の倫理という、より厄介な課題に我々を引き戻すだけなのだ。

技術の進化に追いつけない法整備、その構造的なジレンマ

技術の進化は指数関数的、対する法整備は数年がかりの審議と施行。この絶望的な速度差こそが、生成AIの著作権問題を根深くする構造的な欠陥だ。例えば、日本の著作権法30条の4にある「利益を不当に害する場合」という曖昧な但し書きの解釈は、2026年現在も定まっていない。これでは現場は動けない。EUがAI法で学習データの透明性義務を課したところで、国境を越えるサービスに対し、どこまで実効性があるのか甚だ疑問だ。新たな技術が登場するたびに後追いで解釈をひねり出す「もぐら叩き」を続ける限り、法は技術に永遠に追いつけない。クリエイターは、法が守ってくれるという幻想を捨てるべきだろう。

保護か革新か?専門家でも割れる意見と終わらない議論

生成AIを巡る議論は、「クリエイター保護」と「技術革新」という二元論に陥りがちだが、所詮はポジショントークの応酬に過ぎない。クリエイター団体や報道機関が学習データの透明性やオプトインを求めるのは当然の権利主張だが、それは既存の権益構造を守るための防衛戦でもある。一方で、技術推進派が日本の著作権法第30条の4を「イノベーションの聖域」と崇めるのも、他者の創造物を利用する行為を正当化する都合の良い解釈に他ならない。この終わらない議論の根本には、誰が果実を得るべきかというゼロサムゲームがあり、自主的な取り組みだけで着地点が見つかるはずもないのだ。

まとめ:生成AIと共創する未来へ - クリエイターが持つべき視点とは

生成AIと著作権を巡る議論は、単なる法的な論争ではなく、私たちの創造性の未来そのものを問うています。本記事で解説したように、学習データから生成物の権利、そしてC2PAのような技術標準の動向まで、クリエイターが向き合うべき論点は多岐にわたります。

これからの時代に求められるのは、AIを単なるツールとして消費するのではなく、「共創のパートナー」として捉え、主体的に関与していく姿勢です。プロンプトの記録やガイドライン策定といった具体的なリスク管理は、自らの創作を守り、その価値を証明するための新たな作法となるでしょう。

技術とルールが進化する過渡期の今、私たちはAIといかにして公正で創造的な関係を築いていくのか。その答えは、私たち一人ひとりの選択と行動の中にあります。

より安全で効果的なAI活用にご興味のある方は、ぜひOptiMaxにご相談ください。