なぜ今、製造業でAIの倫理的課題が問われるのか

生産性向上や人手不足解消の切り札として、製造業でのAI活用が加速しています。 しかしその裏側で、AIの判断ミスが信用の失墜に繋がりかねない倫理的課題が深刻化していることはご存知でしょうか。 AIの判断プロセスが不透明な「ブラックボックス問題」や、データの偏りによる意図しない差別など、向き合うべき課題は少なくありません。本章では、なぜ今、AIの倫理に向き合うべきなのか、その具体的な理由と背景を深掘りします。

AIの判断ミス、その責任は誰が負うのか

AIが不良品を見逃したり設備の異常を検知しなかったりした場合、その責任は誰が負うのでしょうか。現状では、AIの開発者、提供事業者、導入企業の間で責任の所在が曖昧になりがちです。 特に製造業では、AIを組み込んだ製品が原因で損害が生じれば、製造物責任法(PL法)に基づき、製品を供給した導入企業が責任を問われる可能性があります。

この問題を複雑にするのが、AIの判断プロセスが不透明な「ブラックボックス問題」です。 万が一事故が起きても、原因究明が困難になるケースが少なくありません。

対策として重要なのは、AIの判断根拠を可能な限り可視化・説明可能にすることと、AI提供事業者との間で保守・運用における責任範囲を契約で明確化しておくことです。株式会社OptiMaxのように、現場を熟知したエンジニアがAIの判断根拠まで丁寧に説明し、導入から運用まで一貫してサポートするパートナーを選ぶことは、こうしたリスクへの有効な備えとなります。

技術伝承のはずがAIのブラックボックス化に

ベテランの「暗黙知」をAIに学習させ、若手へ継承する取り組みが注目される一方、AIの判断プロセスが人間には理解できない「ブラックボックス化」という新たな課題が生まれています。 AIがなぜその結論に至ったのかが不明瞭なため、トラブル発生時の原因究明が遅れたり、若手従業員がAIの判断を鵜呑みにするだけで、思考力や応用力が育たないといった事態を招きかねません。これでは本来の目的である技術伝承が形骸化してしまいます。 重要なのは、AIの判断根拠を可視化し、人間が学びに変えられる仕組みです。現場を深く理解した専門家がデータ収集からUI設計まで伴走し、人とAIが共に成長できる環境を構築することが、真の技術伝承を実現する鍵となります。

AIは人間の仕事を奪う?新たな役割分担とは

AIに仕事を奪われるという懸念は、特に製造業の現場で深刻に受け止められています。しかし、これは悲観的な未来を意味するものではなく、AIと人間の新たな役割分担の始まりと捉えるべきです。

例えば、AIが得意とする外観検査や設備データの監視といった定型的で集中力を要する業務を任せることで、人間は心身の負担が大きい作業から解放されます。 これにより、人はAIでは困難な、より複雑な不良原因の分析や、生産ライン全体の改善提案といった、創造性が求められる高付加価値な業務に注力できるようになります。

さらに、ベテランの暗黙知をAI化し、若手への技術伝承を支援するソリューションも登場しています。AIは人間の仕事を一方的に奪うのではなく、能力を拡張し、人間をより重要な役割へとシフトさせる協働パートナーなのです。

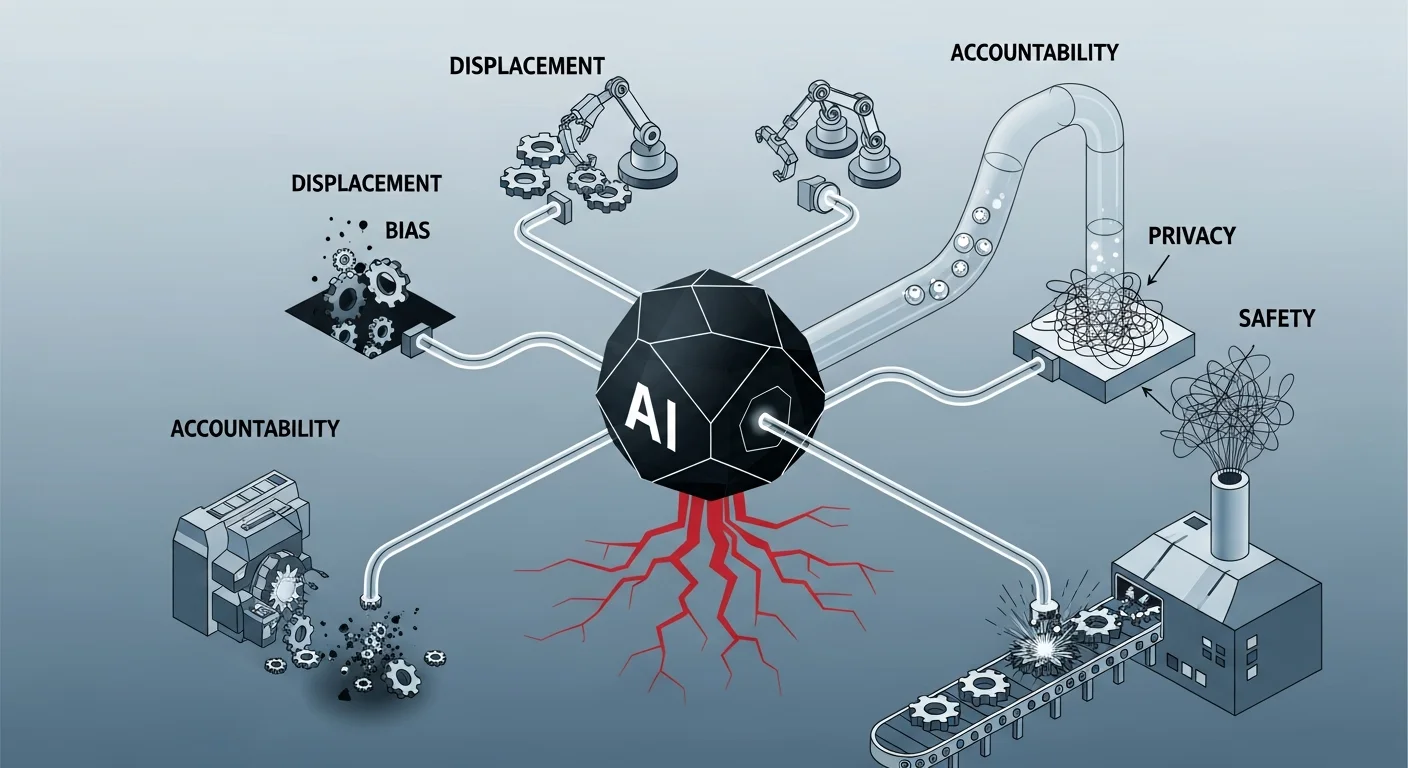

AI導入で直面する5つの倫理的課題と信用の失墜リスク

製造業でのAI導入は生産性向上の鍵ですが、その裏には見過ごせない倫理的な課題が潜んでいます。判断プロセスの不透明さやデータの偏りといった問題は、製品の品質や安全性を脅かし、最終的に企業の信用を根底から揺るがす事態にも発展しかねません。本章では、製造業がAI導入で直面する5つの具体的な倫理的課題と、それに伴う信用の失墜リスクを詳しく解説します。

AIの判断根拠が見えない「ブラックボックス問題」

製造業の現場において、AIがなぜ特定の製品を「不良品」と判定したのか、あるいはなぜ設備に「異常の兆候あり」と結論付けたのか、その判断プロセスが人間には理解できない「ブラックボックス問題」は深刻な倫理的課題です。この問題は、品質改善の具体的なアクションを妨げ、顧客への説明責任を果たせなくなるリスクをはらみます。例えば、AIの判定ミスが起きた際に原因を特定できなければ、再発防止策を講じることができません。

この課題に対処するためには、AIの判断根拠を可視化する「説明可能なAI(XAI)」の技術動向を注視することが重要です。さらに、導入ベンダーを選ぶ際には、AIの専門知識だけでなく、現場の製造プロセスを深く理解しているかを見極める必要があります。エンジニアが現場に常駐し、AIの判断と現場の知見をすり合わせるようなサポート体制があれば、ブラックボックスのリスクを大幅に低減できるでしょう。導入前に、自社のデータでAIの判断精度やその根拠を検証できる「適用可能性診断」などを活用し、納得のいく形で導入を進めることが信用の失墜を防ぐ鍵となります。

データ偏りが引き起こすAIの差別と誤検知リスク

AIの判断精度は、学習に用いるデータの質と量に大きく依存します。 製造業の現場では、正常品のデータに比べ不良品のデータが極端に少ないケースが多々あります。このような偏ったデータでAIを学習させると、AIは正常な状態を「正」と強く認識する一方、稀にしか発生しない不良や未知のパターンの異常を検知できない「誤検知リスク」が高まります。

これは、特定の外観的特徴を持つ製品をすべて不良品と誤判定したり、特定の製造ラインで発生した異常だけを見逃したりといった「AIによる差別」につながりかねません。結果として、品質のばらつきを見過ごし、顧客からの信用を失う原因となります。

こうしたリスクを回避するには、多様なデータをバランス良く学習させることが不可欠です。しかし、現実的に十分な不良品データを集めるのは困難な場合も多いでしょう。そのため、株式会社OptiMaxが提供するような、少ないデータでも高精度な判定を可能にするアノテーション技術や、AIの専門家によるデータ収集・設計支援といったアプローチが有効な解決策となります。

AIの判断ミスは誰の責任?曖昧な責任の所在

製造現場でAIが不良品を見逃したり、設備の故障予知を誤ったりした場合、その責任はAIの開発者、導入した企業、現場の管理者、一体誰が負うのでしょうか。現状、AIの判断ミスに対する責任の所在は非常に曖昧であり、法整備も追いついていないのが実情です。 この問題は、品質トラブルによる顧客からの信頼失墜に直結する、製造業にとって看過できない経営リスクとなります。

こうしたリスクを軽減するには、AIの判断根拠を人間が理解できる形で示し、検証できる仕組みが不可欠です。 さらに、株式会社OptiMaxが提供するソリューションのように、専門エンジニアが現場の運用を深く理解した上で、操作ミスを誘発しないUIを設計したり、導入後のサポート体制が充実していたりするパートナーを選ぶことが重要です。AIの導入から運用まで一気通貫で支援する信頼できる専門家と連携することが、万が一の事態に備え、企業の責任を明確化する第一歩となるでしょう。

AIの判断、誰が責任を負うのか?ブラックボックス問題の深刻性

AIの導入が生産性を飛躍的に向上させる一方、その判断プロセスが不透明な「ブラックボックス問題」は、製造業において深刻な倫理的課題となっています。AIによる検品ミスで不良品が流出してしまった場合、その責任は一体誰が負うのでしょうか? 判断の根拠が分からないAIは、現場の混乱を招き、企業の信用を失いかねません。本セクションでは、AIの判断における責任の所在と、そのリスクについて深掘りします。

AIによる事故、その責任は開発者か使用者か

AIによる事故が発生した場合、その責任は開発者か使用者か、という問いは製造業にとって非常に重要です。現状、AIに関連する事故の責任の所在は法律で明確に定められておらず、ケースバイケースでの判断となることがほとんどです。

例えば、AI外観検査システムが不良品を見逃した場合を考えてみましょう。その原因が、AIモデルの設計や学習データの偏りにあった場合は開発者側の責任が問われる可能性があります。一方で、メーカーが推奨していない照明環境で検査を行ったり、AIが異常を通知したにもかかわらず従業員が無視したりした場合は、使用者側の責任が重くなります。

このように、責任の所在はAIの「ブラックボックス」の内部だけでなく、その運用体制にも深く関わります。 重要なのは、開発者と使用者が導入段階から密に連携し、リスクを共有することです。具体的には、操作ミスを誘発しにくいUI設計や、現場の環境に合わせたデータ収集・実装までサポートしてくれるパートナーを選定することが、予期せぬ事故とそれに伴う信用の失墜を防ぐ鍵となるでしょう。

判断根拠が不明なAIが招く品質トラブルとは

AIの判断根-拠が不明な「ブラックボックス」状態は、製造現場で深刻な品質トラブルを招く危険性をはらんでいます。例えば、AIを用いた外観検査で不良品が検知されても、なぜAIがそれを「不良」と判断したのかという具体的な理由が分からなければ、根本的な原因究明や再発防止策を講じることが困難です。 その結果、同じ不良が繰り返し発生し、最悪の場合は不良品が市場へ流出することで、大規模なリコールや顧客からの信頼失墜に繋がりかねません。このようなリスクを回避するためには、AIの判断根拠を人間が理解できる形で提示する「説明可能なAI(XAI)」の導入が不可欠です。 専門家による診断を通じて、自社の課題やデータ状況に適したAIソリューションを選定することが、品質トラブルを未然に防ぐ鍵となります。

透明性が鍵となる「説明可能なAI(XAI)」

AIの判断がブラックボックス化し、現場の混乱や不信感を招く問題の解決策として「説明可能なAI(XAI)」が注目されています。 これは、AIが「なぜその結論に至ったのか」という判断の根拠やプロセスを、人間が理解できる形で提示する技術です。

製造業の現場では、例えばAIによる外観検査で不良品と判定された際に、AIが製品のどの部分の、どのような特徴(傷や異物など)を根拠としたのかをヒートマップで可視化できます。 また、設備の予知保全においては、どのセンサーデータが故障の予兆と判断されたのかが具体的に分かります。

このように判断根拠が透明化されることで、品質管理や保全の担当者はAIの判定基準の曖昧さを解消し、より的確な改善アクションに繋げることが可能です。株式会社OptiMaxのように、現場を熟知したエンジニアがAIの判断根拠を直感的に理解できるUIを設計し、導入を支援するサービスも登場しており、AIとの信頼関係を築く上で重要な役割を果たします。

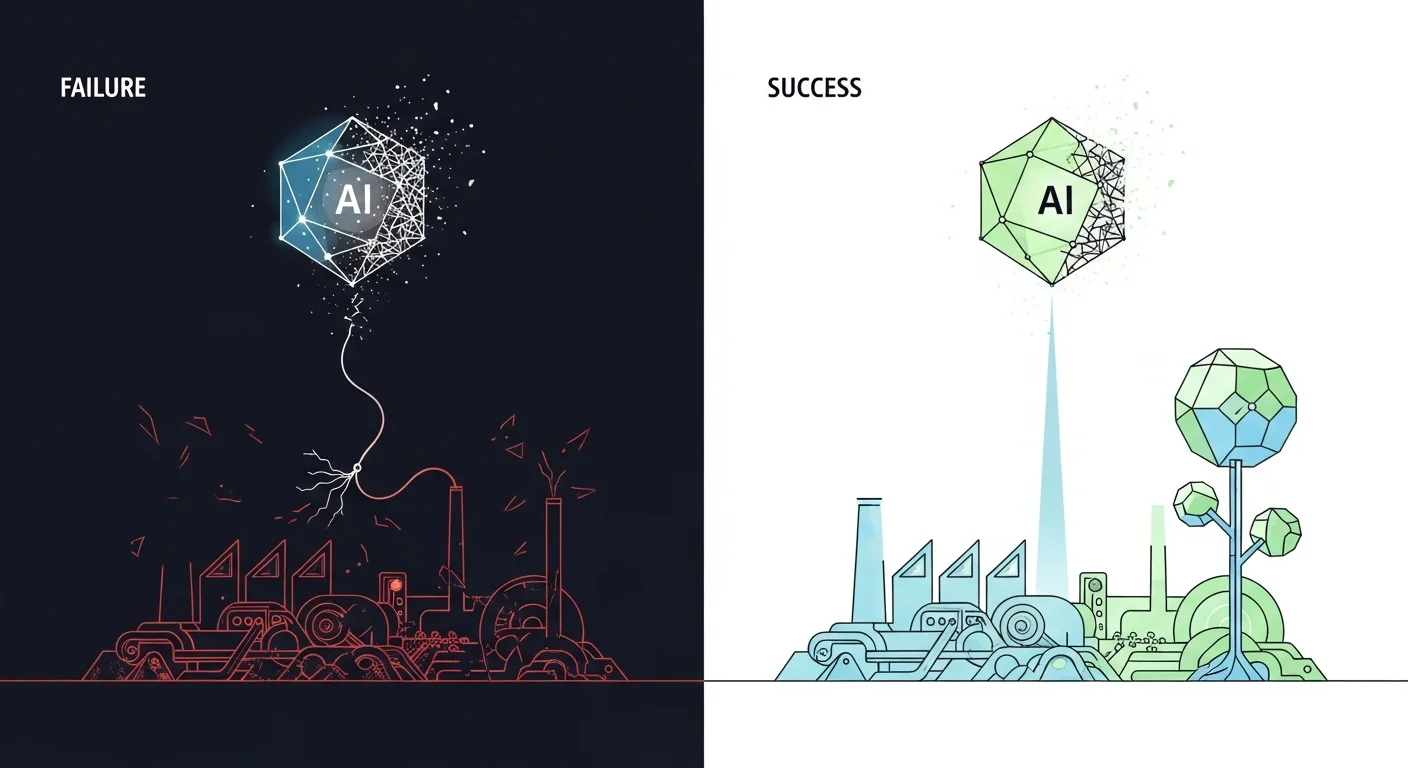

「現場軽視」が招くAI導入の失敗と、信頼されるAIの条件

製造業におけるAI導入が「絵に描いた餅」で終わる原因の多くは、「現場軽視」にあります。 経営層の期待とは裏腹に、現場の作業員がAIを信頼できず、結局使われなくなってしまうのです。 これでは、生産性向上どころか、新たな混乱を生むだけです。本セクションでは、AIが現場の「敵」ではなく「味方」として受け入れられ、真の価値を発揮するために不可欠な「信頼の条件」と、その根底にあるべき倫理観について解説します。

「使えないAI」を生む、現場不在のシステム開発

机上の空論で進むAI開発は、現場の実情と乖離した「使えないAI」を生む典型的な失敗パターンです。 開発者が工場の環境を理解しないままでは、熟練作業員の「勘」といった暗黙知をデータ化できず、操作しにくいUIを設計してしまいかねません。このようなAIは、かえって現場の負担を増やし、検品ミスなどを誘発するリスクさえはらんでいます。これは従業員の安全や製品の品質に関わる、製造業としての倫理的な課題に直結する問題です。 失敗を防ぐには、開発の初期段階から現場を巻き込み、AIの専門家が実際に作業を理解しようと努めることが不可欠です。 現場に寄り添い、泥臭いデータ収集から伴走する開発プロセスこそが、本当に価値のあるAIシステムを実現する鍵となります。

信頼の鍵は「職人技」をAIに学習させること

現場で信頼されるAIを構築する鍵は、熟練技術者が持つ「職人技」をAIに学習させることにあります。製品の微細な傷を見抜く目や、機械の異音を聞き分ける耳といった、言語化が難しい「暗黙知」は、AIにとって最高の教師データです。 このアプローチにより、AIは単なる自動化ツールではなく、熟練者の判断基準をデジタル資産として継承するパートナーへと進化します。 例えば、不良品データが少ない状況でも、ベテランの検査員による「良品・不良品の判断基準」をAIに学習させることで、判定精度を均質化し、若手への技術伝承も促進できます。 このように現場の知見を尊重するプロセスこそが、AIへの信頼を育むのです。

導入後の定着を左右する「誰もが使える」操作性

高精度なAIを導入しても、現場の作業員が使いこなせなければ意味がありません。むしろ、複雑な操作を強いるシステムはヒューマンエラーを誘発し、品質トラブルの原因となりかねず、AIへの不信感を増大させます。これでは、生産性向上どころか、従業員のエンゲージメント低下という倫理的な問題にもつながりかねません。

AIが現場に信頼され、定着するためには、専門知識がなくても直感的に操作できるUI(ユーザーインターフェース)が不可欠です。 例えば、外観検査AIであれば、不良品の判定理由を画像上で分かりやすく可視化したり、予知保全AIであれば、故障の予兆を誰もが理解できるアラートで通知したりする工夫が求められます。

こうした現場目線のUI設計は、ベテランから若手まで誰もがAIを「業務を効率化するパートナー」として受け入れる土壌を育みます。結果として、AIはスムーズな技術伝承を後押しし、企業全体の競争力強化に貢献するのです。

ベテランの技術伝承をAIで実現し、失われる技術を防ぐ

製造業が直面する人手不足と高齢化の波は、技術伝承の断絶という深刻な課題を生んでいます。 長年培われてきた職人芸、特にマニュアル化が難しい「暗黙知」が失われれば、企業の競争力そのものが揺らぎかねません。 本章では、こうした失われゆく技術をAIによってデジタル資産化し、次世代へ継承する具体的な方法を解説します。 AIは技術を奪うのではなく、むしろ人と共存し、貴重なノウハウを守り育てるための強力な味方となるのです。

AIが熟練者の「勘とコツ」をデータ化し継承

製造業の現場では、熟練者の「勘」や「コツ」といった暗黙知が品質を支えていますが、その継承はOJT頼みで言語化が難しく、属人化の大きな課題となっていました。 しかし、AI技術の進化により、この「見て覚えろ」という伝統的な手法からの脱却が可能になっています。

センサーや高精細カメラを用いて、熟練者の動き、加工時の微細な振動や音などをデータとして収集・解析することで、これまで継承が困難だった職人芸をデジタル資産として形式知化します。 例えば、収集したデータを基に、若手作業者の手元をリアルタイムで解析し、最適な工具の角度や力加減をARグラスに表示する「技能AIアシスタント」のような仕組みを構築できます。

これにより、経験の浅い作業者でもベテランに近い水準での作業が可能となり、教育期間の短縮と品質の安定化に大きく貢献します。AIは、失われつつある貴重な技術を守り、未来へ繋ぐための強力なツールとなるのです。

技能AIアシスタントで若手教育の時間を70%削減

従来のOJT(On-the-Job Training)では、指導者のスキルによる教育の質のばらつきや、言語化しにくい「勘」や「コツ」といった暗黙知の伝承が大きな課題でした。 技能AIアシスタントは、この課題を解決する有効な一手です。

具体的には、ベテラン技術者の手の動きや判断基準をセンサーやカメラでデータ化し、AIに学習させます。 若手作業者は、タブレットやARグラスを通してAIからリアルタイムで指示を受けたり、作業の正誤判定を即座にフィードバックしてもらったりすることが可能です。これにより、指導者が付きっきりになる必要がなくなり、若手教育の時間を70%削減しつつ、技術の標準化を実現します。

AIはあくまで熟練者の技術をデジタル資産として継承し、サポートする役割を担います。 この仕組みは、単なる効率化だけでなく、人による技術の最終判断を尊重し、企業の競争力の源泉である貴重なノウハウを次世代へつなぐための倫理的かつ持続可能な投資と言えるでしょう。

属人化した技術をデジタル化し、組織の資産に

ベテラン従業員の退職に伴い、長年培われた「職人芸」ともいえる貴重な技術が失われることは、製造業における深刻な課題です。これまで言語化が難しかった勘やコツといった属人化した技術を、AIを用いてデジタル化する動きが加速しています。 例えば、センサーやカメラで熟練者の動きや判断基準をデータとして収集・解析し、AIに学習させることが可能です。

このようにしてデジタル化された技術は、組織の共有資産として蓄積されます。 具体的には、若手従業員向けの「技能AIアシスタント」として活用し、教育時間を短縮したり、検査基準を標準化して製品の品質を安定させたりできます。個人の暗黙知を組織の形式知へと転換することは、技術伝承の課題を解決するだけでなく、顧客からの信頼を維持し続けるという企業の倫理的責任を果たす上でも不可欠です。

信用を築くためのAIガバナンスとパートナー選びの重要性

AI導入による生産性向上は魅力的ですが、その判断基準がブラックボックス化すれば、顧客や社会からの信用を失いかねません。製造業がAIの恩恵を享受し続けるためには、倫理的な課題に対応する「AIガバナンス」の確立が不可欠です。 そして、その実現には、技術的な支援だけでなく、現場の課題から倫理的配慮までを共に考え実装できる「パートナー選び」が成功の鍵を握っています。

現場が納得するAIか?導入プロセスの透明性

AI導入を成功させる鍵は、現場の従業員がその判断を信頼し、納得できるかにかかっています。判断プロセスが不透明な「ブラックボックス」化したAIは、現場の不信感を招き、せっかく導入しても形骸化するリスクを孕んでいます。

そこで重要になるのが、導入プロセスの透明性です。なぜAIが特定の判断を下したのか、その根拠を人間が理解できる説明可能性(XAI)の確保が不可欠です。

そのためには、開発の初期段階から現場の担当者を巻き込み、共にAIを「育てる」という視点が欠かせません。例えば、AI開発の専門家が現場に足を運び、ベテランの知見をAIに学習させたり、操作ミスが起きにくい画面設計を共同で進めたりするプロセスは、現場の納得感を高め、スムーズなAI活用へと繋がります。まずは自社の課題を専門家と共に洗い出す「適用可能性診断」から始めるのも有効な手段です。

技術力より現場理解。伴走型パートナーの見極め方

AI導入の成否は、技術力以上に現場への深い理解を持つパートナーを選べるかにかかっています。見極めのポイントは、エンジニアが実際に工場へ足を運び、データ収集から実装まで伴走してくれるかです。また、既存のPLCやセンサーを活かす提案や、不良品データが少ない状況でも精度を出す独自の技術力も重要です。さらに、AIは現場の作業者が日常的に使うものだからこそ、操作ミスを誘発しないUI設計ができるかは欠かせない視点でしょう。机上の空論ではなく、製造現場の特有の課題に真に寄り添い、共に解決を目指す姿勢を持つパートナーこそが、信頼に足る選択といえます。

PoCで終わらせない。無料診断で確かめる事業貢献度

製造業のAI導入において、多くの企業が「PoC(概念実証)の壁」に直面します。 「AIで何ができるか」という技術検証で終わってしまい、実際の業務改善や事業貢献に繋がらないケースは少なくありません。

PoCで終わらせないためには、導入前に費用対効果を具体的に把握し、投資判断の材料を揃えることが不可欠です。そこで有効なのが、実際のデータを用いた無料診断の活用です。例えば、株式会社OptiMaxが提供する「AI外観検査・予知保全 適用可能性診断」では、実際の製品サンプルや設備データから、AIでどの程度の精度が出るかを無料で検証できます。

このような診断を活用し、事業貢献度を事前に見極めることが、信頼性の高いAI導入を実現し、現場の納得感を得ながらプロジェクトを成功に導く鍵となります。ものづくり補助金の活用シミュレーションと併せて、リスクを抑えた現実的な導入計画を立てましょう。

まとめ

本記事では、製造業におけるAI導入の倫理的課題と、信用の失墜を防ぐためのポイントを解説しました。AIの判断における責任の所在の明確化や、ブラックボックス問題への対策は、顧客や従業員からの信頼を得る上で不可欠です。

また、AIを単なる監視ツールではなく、ベテランの技術伝承や現場の負担軽減に活用することが、従業員との信頼関係を築く鍵となります。 製造業でAI倫理を遵守し、真の価値を創出するには、技術力だけでなく現場を深く理解するパートナー選びが重要です。自社の課題にAIがどう貢献できるか、まずは専門家による「適用可能性診断」などを活用し、具体的な一歩を踏出してみてはいかがでしょうか。