AIの「トークン」とは?生成AIの思考を形作る最小単位の正体

ChatGPTやGeminiといった生成AIが、私たちの言葉をどのように理解し、思考しているのか。その驚異的な能力の根源には「トークン」という最小単位の存在があります。これは単なる単語とは異なり、AIが情報を処理し、応答を組み立てるための基礎部品です。2026年現在、最新モデルは文庫本10冊分に相当する100万トークンもの情報を一度に扱えるようになりました。では、このトークンとは一体何なのか?そして、なぜそれがAIの性能や利用コストを直接左右する「鍵」となるのでしょうか。その本質を解き明かします。

単語とは違う?AIがテキストを処理する最小単位の仕組み

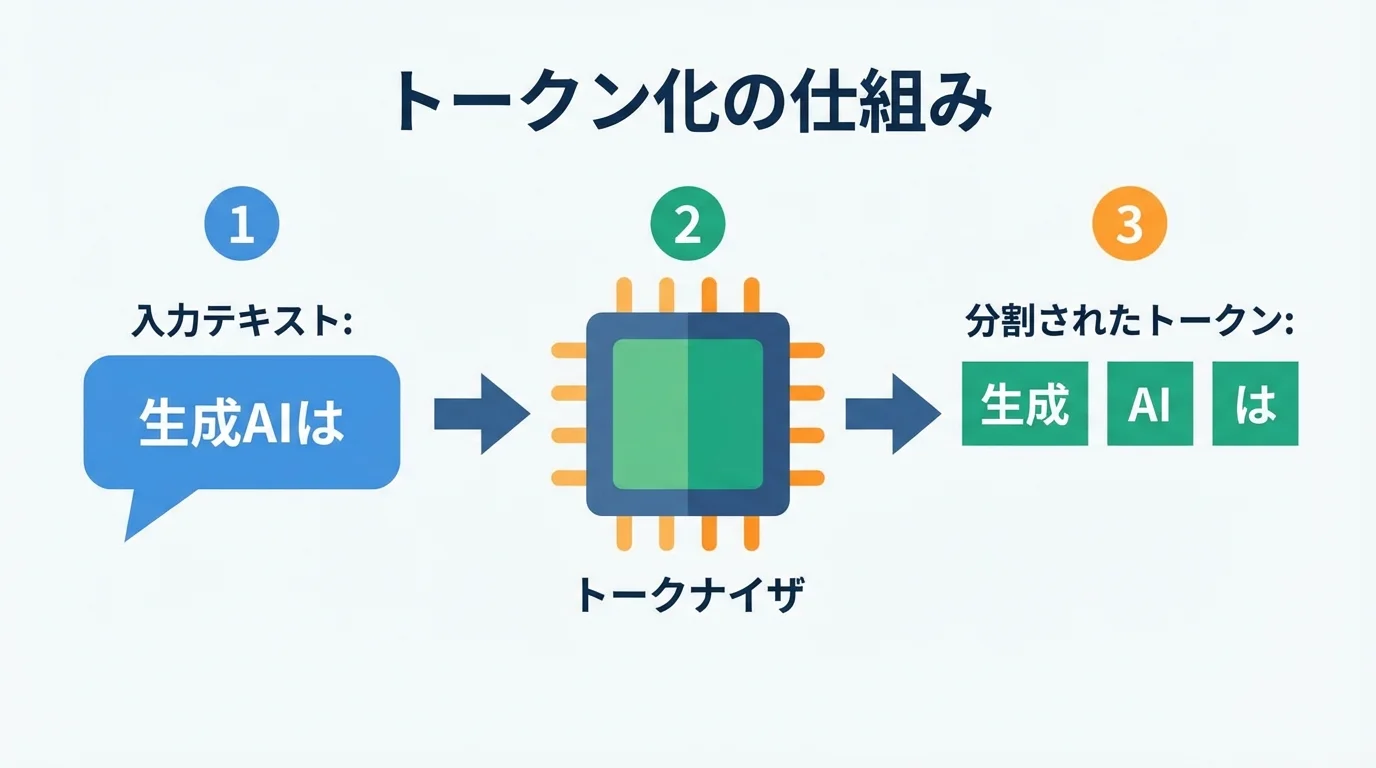

AIは人間のように単語をそのまま認識しているわけではありません。テキストが入力されると、「トークナイザ」という仕組みがそれをAIが理解できる最小単位「トークン」へと分割します。これは単語より細かい「サブワード」であることが多く、例えば「生成AIは」が「生成」「AI」「は」のように分割されます。この方式により、未知の単語にも柔軟に対応し、計算効率を高めることが可能です。

このトークン化の概念は、2026年現在、テキストの領域を大きく超えています。最新のモデルでは、画像や音声、動画といった多様なデータも統一的なトークンに変換し、世界を統合的に理解しようとしています。こうしたマルチモーダルAIの今後を占う上でも、トークンの仕組みは欠かせない知識と言えるでしょう。この根源的なアプローチこそが、LLMとは何かを理解する鍵となります。

あわせて読みたい

マルチモーダルAI とはについて、導入方法から活用事例まで詳しく解説します。

LLM とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

トークンがAIの性能を左右する?コストにも関わる重要性

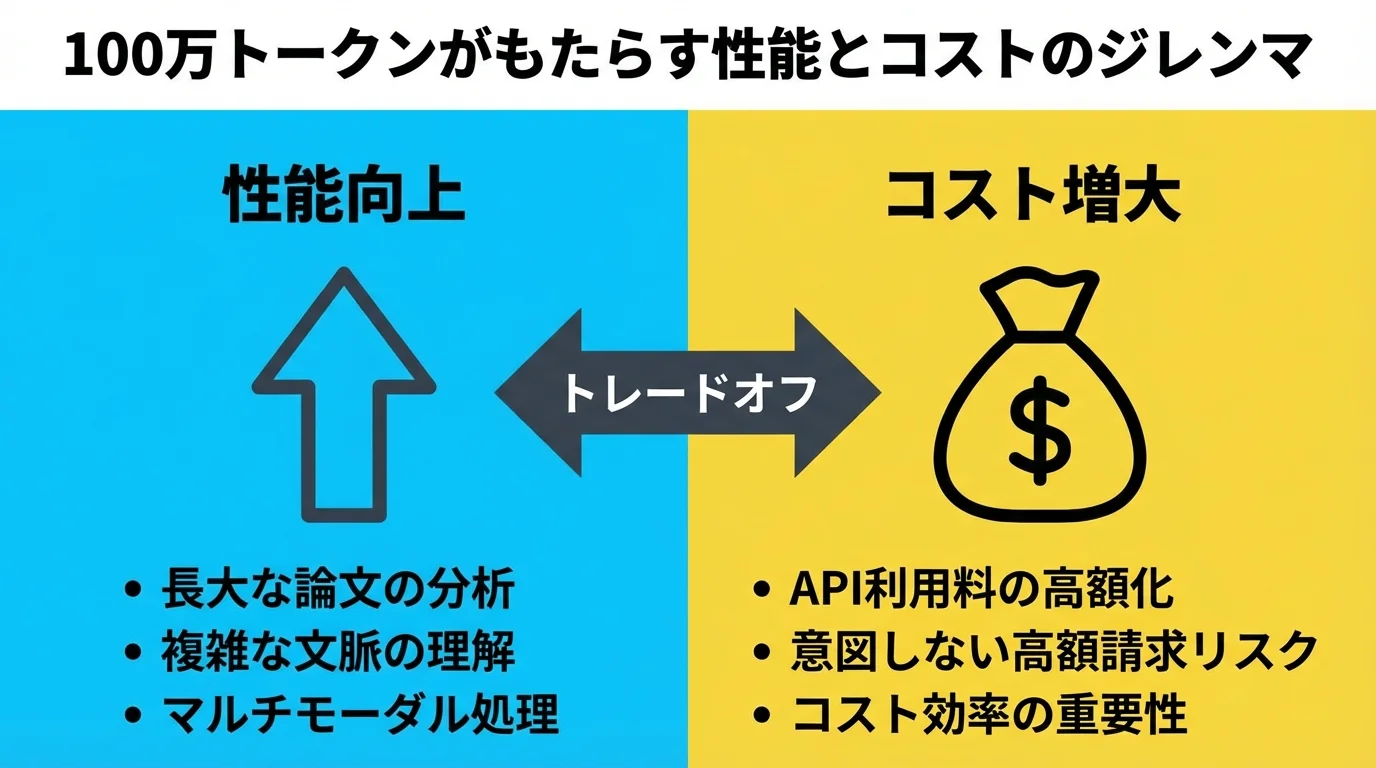

トークンは、AIの性能とコストを直接的に左右する、まさに生命線です。2026年現在、GoogleのGemini 3.1 Proなどが実現した100万トークン級の巨大なコンテキストウィンドウは、AIに文庫本10冊分もの情報を一度に記憶・処理する能力を与えました。これにより長大な論文の分析や、テキスト以外の情報を扱うマルチモーダルAIの今後を切り拓くなど、AIの能力は飛躍的に向上しています。一方で、トークン数はAPI利用料に直結するため、この長大なコンテキストは高額請求のリスクも生み出します。アリババの「千問3.5」のようにコスト効率を追求したモデルも登場しており、性能と経済性のバランスをどう取るかは、企業が生成AI導入で得られるメリットとは何かを考える上で、極めて重要な判断基準となっています。

あわせて読みたい

マルチモーダルAI とはについて、導入方法から活用事例まで詳しく解説します。

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

日本語の「トークン」はどう数える?具体例で理解する基本

英語が主に単語単位で区切られるのに対し、日本語のトークンは直感的に数えるのが難しいという特徴があります。これは、ひらがな・カタカナ・漢字が混在し、単語の区切りが明確でない言語的特性に起因します。例えば「AIの進化を考える」という短い文でも、モデルによっては「AI」「の」「進化」「を」「考え」「る」のように分割されます。特に漢字は1文字で複数のトークンとして扱われることも多く、結果として同じ意味内容でも英語よりトークン数が多くなる傾向にあります。この「トークン効率」の違いは、API利用時のコストに直結するため、LLMとは何かを比較検討する際の重要な指標の一つと言えるでしょう。各サービスが提供するトークナイザのツールで、事前に確認する習慣が求められます。

あわせて読みたい

LLM とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

100万トークン時代の到来!AIが直面する性能とコストのジレンマ

2026年、AIの世界は「100万トークン」という新たな地平に到達しました。GoogleのGemini 3.1 Proに代表される最新モデルは、長大な論文や書籍さえも一度に処理できる驚異的な能力を獲得しています。しかし、この飛躍的な性能向上の裏側で、私たちは無視できない課題に直面しています。それは、トークン量に比例して増大するコストという現実です。果たして私たちは、この性能とコストのジレンマにどう向き合うべきなのでしょうか。

100万トークンが可能にした!AIの常識を覆す長文処理能力

100万トークンという圧倒的なコンテキストウィンドウは、AIの能力を量的に拡大しただけではありません。それはAIの思考の質そのものを根底から覆すものです。例えば、GoogleのGemini 3.1 Proなどは、文庫本10冊分に相当する膨大な情報を一度に読み込み、複雑な文脈を維持したまま対話できます。これにより、従来は専門家チームが数日を要した数百ページの研究論文や企業の決算報告書を瞬時に分析・要約することが可能になりました。これは企業が生成AI導入で得られるメリットとは、まさに実例と言えるでしょう。さらに、長時間の会議動画から議事録を自動生成するといった、マルチモーダルAIの今後を占う活用も現実のものとなっています。もはやAIは単なるツールではなく、文脈を深く理解する専門家アシスタントと呼ぶべき存在に進化したのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

マルチモーダルAI とはについて、導入方法から活用事例まで詳しく解説します。

高性能化の代償?無視できないトークンコスト増大の課題

100万トークンという驚異的な処理能力は、諸刃の剣でもあります。その裏側で、トークンコストという無視できない課題が深刻化しているのです。特に、自律的に思考と実行を繰り返すAIエージェントは、人間が見えないところで膨大なトークンを消費するため、意図せずAPI利用料が高額化するケースが後を絶ちません。この流れを受け、アリババの「千問(Qwen)3.5」のように、性能を維持しつつコストを競合の5%に抑えるモデルが登場するなど、業界の関心は純粋な性能競争からコストパフォーマンスへとシフトしつつあります。今後、企業が生成AI導入で得られるメリットとは何かを考える上で、このトークンあたりの経済性をいかに最適化するかが、成功の分水嶺となるでしょう。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

「性能」と「コスト」の板挟み?AI利用者が直面する現実

100万トークンがもたらす圧倒的な性能は、同時に「無計画な利用は高コストに直結する」という厳しい現実を突きつけます。利用者は常に性能と費用の天秤にかけられ、特に自律型AIエージェントのように裏側で大量のトークンを消費するアプリケーションでは、このジレンマが事業の成否を分けることさえあります。

しかし、この課題に対する解決策も登場しています。アリババの「千問(Qwen)3.5」のように、トップクラスの性能を維持しながらコストを競合の5%に抑えるモデルが登場し、コストパフォーマンスという新たな選択基準が生まれました。

これからは、常に最高性能のモデルを使うのではなく、用途に応じて最適なモデルを使い分ける賢い戦略が求められます。全てを長大なコンテキストに頼るのではなく、RAG(検索拡張生成)技術と組み合わせることで、企業が生成AI導入で得られるメリットとはを最大化できるでしょう。「性能かコストか」という二者択一の時代は、終わりを迎えつつあるのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

なぜ今「トークン」が重要なのか?AIエージェントと超巨大モデル化がもたらすパラダイムシフト

100万トークンという圧倒的な処理能力は、単にAIが長文を扱えるようになった以上の、根源的な変化をもたらしています。その本質は、AIが自ら計画・実行する「AIエージェント」の台頭と、モデルの潜在能力を解き放つ「超巨大モデル化」という二つの潮流に集約されます。なぜ今、トークンは単なる処理単位を超え、AIの「自律性」を支える鍵となったのでしょうか。ここから、AIの役割そのものを変えつつあるパラダイムシフトの正体に迫ります。

自律型AIエージェントの思考を支える長大な記憶の正体

自律型AIエージェントが複雑なタスクを自己完結で遂行できる背景には、その驚異的な「記憶力」があります。この記憶の正体こそ、文庫本10冊分に相当する100万トークン級の超長大なコンテキストウィンドウです。しかし、AIは単に情報を無尽蔵に詰め込んでいるわけではありません。「SnapKV」のようなメモリ効率化技術や、重要情報を凝縮して記憶するコンテキスト圧縮技術によって、膨大な情報の中から本当に必要な文脈だけを効率的に保持・参照しているのです。これにより、AIは長期的な対話や膨大な資料の内容を忘れずに「思考」し続けることが可能になりました。この進化は、LLMとは何かという問いの答えを、単なる言語モデルから真の知的パートナーへと引き上げる可能性を秘めています。

あわせて読みたい

LLM とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

超巨大モデルの知性を解放するトークンという名の鍵

超巨大モデルが持つ天文学的なパラメータ数は、いわば巨大な図書館です。しかし、蔵書を使いこなす司書がいなければ、その知識は眠ったままです。その司書の役割を担うのが、進化したトークン技術に他なりません。例えば、必要な専門家(Expert)だけを稼働させるMixture-of-Experts (MoE)アーキテクチャは、巨大なモデルを現実的なコストで動かすことを可能にしました。さらに、テキストだけでなく画像や音声も統一トークンとして扱うマルチモーダルAIの今後の潮流は、モデルが世界をより深く、多角的に理解する扉を開いています。トークン技術の進化は、単なる量的な拡大を真の知性へと昇華させる、不可欠な鍵なのです。

あわせて読みたい

マルチモーダルAI とはについて、導入方法から活用事例まで詳しく解説します。

「命令」から「自律」へ、AIの役割を変えるパラダイムシフト

トークン処理能力の飛躍的な向上は、AIの役割を根底から覆しています。かつて人間が逐一指示を与えなければ動かなかったAIは、今や自ら計画を立て、タスクを完遂する自律的なエージェントへと進化を遂げました。2026年現在、Anthropicの「Claude Code」のように、自然言語の曖昧な指示だけでコーディングからデバッグまでを自律的に行うツールも登場しています。これは、AIが単なる「命令」を待つツールから、目的を共有し協働するパートナーへと変わったことを象徴する出来事です。このパラダイムシフトは、企業が生成AI導入で得られるメリットとはその質をも変え、業務プロセスそのものを再定義する可能性を秘めています。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

【2026年最新】100万トークンが標準に!AIトークン技術の3大トレンドを徹底解説

AIが文庫本10冊分の情報を一度に記憶する「100万トークン時代」。しかし、真の革新はその先にあります。今、水面下で進むのは、①超長文コンテキストの標準化、②画像や音声をも飲み込むマルチモーダル化、そして③コストと速度を両立する効率化という3つの巨大な潮流です。Gemini 3.1 Proなどが示すこの変化は、私たちのAI利用をどう塗り替えるのでしょうか。その最前線を紐解いていきましょう。

①超長文コンテキストが標準化!AIの記憶力は新たな次元へ

2026年、AIの「記憶」の概念は根本から覆されました。GoogleのGemini 3.1 ProやAnthropicのClaude Opus 4.6などが搭載する100万トークンのコンテキストウィンドウが標準となり、AIはもはや短期記憶に頼る存在ではなくなったのです。これは、数百ページに及ぶ決算報告書や大規模なコードベース全体を一つの文脈として完全に保持し、深い洞察を引き出す能力の獲得を意味します。この驚異的な記憶力は、企業が生成AI導入で得られるメリットとはを飛躍的に高める一方、「大海の針」問題のように長文中の特定情報を見落とすリスクも指摘されています。とはいえ、この変化はAIが単なる応答ツールから、長期的な文脈を共有する知的パートナーへと進化する大きな一歩なのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

②画像・音声もトークン化!マルチモーダル統合という新潮流

2026年のAIにおけるトークンの進化は、テキスト処理能力の向上だけに留まりません。真のパラダイムシフトは、画像や音声、動画といった多様なデータをテキストと同じ「トークン」として統一的に扱う、マルチモーダル統合という新潮流にあります。かつてはデータ形式ごとに専門モデルが必要でしたが、GoogleのGemini 3.1 Proのような最新モデルは、あらゆる情報を統一的なトークンに変換し、言語モデルと同じ「次トークン予測」の原理で処理します。この技術革新は、マルチモーダルAIの今後を大きく変えるものであり、AIがもはや単なる「言語」モデルではなく、あらゆる情報を統合的に理解する「世界認識モデル」へと変貌しつつあることを示唆しています。

あわせて読みたい

マルチモーダルAI とはについて、導入方法から活用事例まで詳しく解説します。

③コストと速度を改善!トークン効率化を巡る技術革新

100万トークンという圧倒的な処理能力は、一方で膨大な計算コストと応答速度の低下という新たな課題を生み出しました。このジレンマを解決する鍵が、トークンあたりの処理を劇的に効率化する技術革新です。その代表格が「Mixture-of-Experts (MoE)」アーキテクチャ。巨大なモデル全体を動かすのではなく、タスクに応じて必要な専門家(Expert)部分だけを稼働させることで、性能を維持しつつ計算コストを大幅に削減します。実際に、アリババの「千問(Qwen)3.5」は競合の数十分の一という驚異的なトークン単価を実現しており、こうした低コスト化は、自律的に思考を繰り返すAIエージェントの実用化を後押しします。これは、企業が生成AI導入で得られるメリットとは何かを考える上で、無視できない変化と言えるでしょう。AIの進化は、単なる大規模化から「賢く、安く、速く」という新たなフェーズに突入しているのです。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

1000万トークン超えも視野に?トークンの進化が切り拓く生成AIの未来像

文庫本10冊分を記憶する100万トークンが標準となった今、AI開発の最前線はすでに次なる地平を見据えています。研究レベルでは「1000万トークン」という桁違いのコンテキストを扱う技術が登場しており、小説1冊を丸ごと理解するAIパートナーや、個人の全生涯を記憶する究極のパーソナルAIアシスタントの実現も夢物語ではなくなりました。この圧倒的な記憶力は、AIと人間の関係をどのように変えるのでしょうか。本章では、トークン技術の進化がもたらす、SFを超える未来像とその実現可能性に迫ります。

小説1冊を丸ごと記憶し対話するAIパートナーの誕生

100万トークンが標準となった今、AIは単なる情報処理ツールから、私たちの記憶を拡張する存在へと進化しています。例えば、お気に入りの長編小説を丸ごとAIに読み込ませれば、登場人物の心情や伏線まで完全に理解した読書パートナーが誕生します。「あの場面の主人公の気持ちを、別の登場人物の視点から語って」といった、物語世界の文脈を深く理解していなければ不可能な対話が現実のものとなるのです。これは、GPT-5.2などが備える巨大なコンテキストウィンドウと、情報を効率的に保持する新しい記憶アーキテクチャが可能にした未来像です。小説だけでなく、個人の全記録を記憶させれば、AIは私たちの人生の文脈を理解する真の相棒となり得るでしょう。この進化は、LLMとは何かという問いの、一つの答えを示しています。

あわせて読みたい

LLM とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

1000万トークンを実現する次世代AIアーキテクチャ

100万トークンから1000万トークンへの飛躍は、単なる力技のメモリ拡張では実現できません。その裏側では、AIの「思考」の仕組み自体を再設計する、根本的なアーキテクチャ革新が進行しています。鍵となるのが、巨大モデルの一部だけを稼働させるMoE(Mixture-of-Experts)です。これにより、膨大なコンテキストを扱いながらも計算コストを現実的な範囲に抑制します。さらに、単に情報を保持するのではなく、重要な文脈を要約して記憶する「コンテキスト圧縮」や、必要な知識を辞書のように高速参照する「Engram」といった新技術が登場。これは、AIが巨大な記憶装置から、人間のように効率的な記憶戦略を持つ存在へと進化していることを意味します。こうした革新が、LLMとは何かという問いの答えを、根底から書き換えようとしているのです。

あわせて読みたい

LLM とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

全生涯を記憶する?究極のパーソナルAIアシスタント

1000万トークンという地平は、SFで描かれた「全生涯を記憶するAI」を現実のものにします。過去の全メール、チャット履歴、読んだ本、日々の健康データまでを記憶し、ユーザーの価値観や文脈を完全に理解した、究極のパーソナルAIアシスタントが誕生するのです。これは単なる長期記憶ではなく、「コンテキスト圧縮」や重要な情報を高速参照する「Engram」といった新技術が、AIの記憶をより人間に近い形へ進化させることで実現します。プライバシーやコストといった課題は残るものの、AIが自分の「分身」として思考を補助する未来は、なぜ今これほどAIが注目されるのか、という問いへの一つの答えとなるでしょう。

あわせて読みたい

生成AI とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

トークン効率を最大化せよ!新時代のAIを賢く活用するための実践的アプローチ

100万トークンという広大なコンテキストウィンドウは、強力な武器であると同時に、コスト増大という諸刃の剣でもあります。特に、自律的に稼働するAIエージェントは、裏側で想像以上のトークンを消費しかねません。AIの性能を最大限に引き出しつつ、無駄なコストを徹底的に削ぎ落とすには、どうすればよいのでしょうか。本章では、プロンプト設計の鉄則から戦略的なモデル選択術まで、明日から使えるトークン効率化の実践的アプローチを徹底解説します。

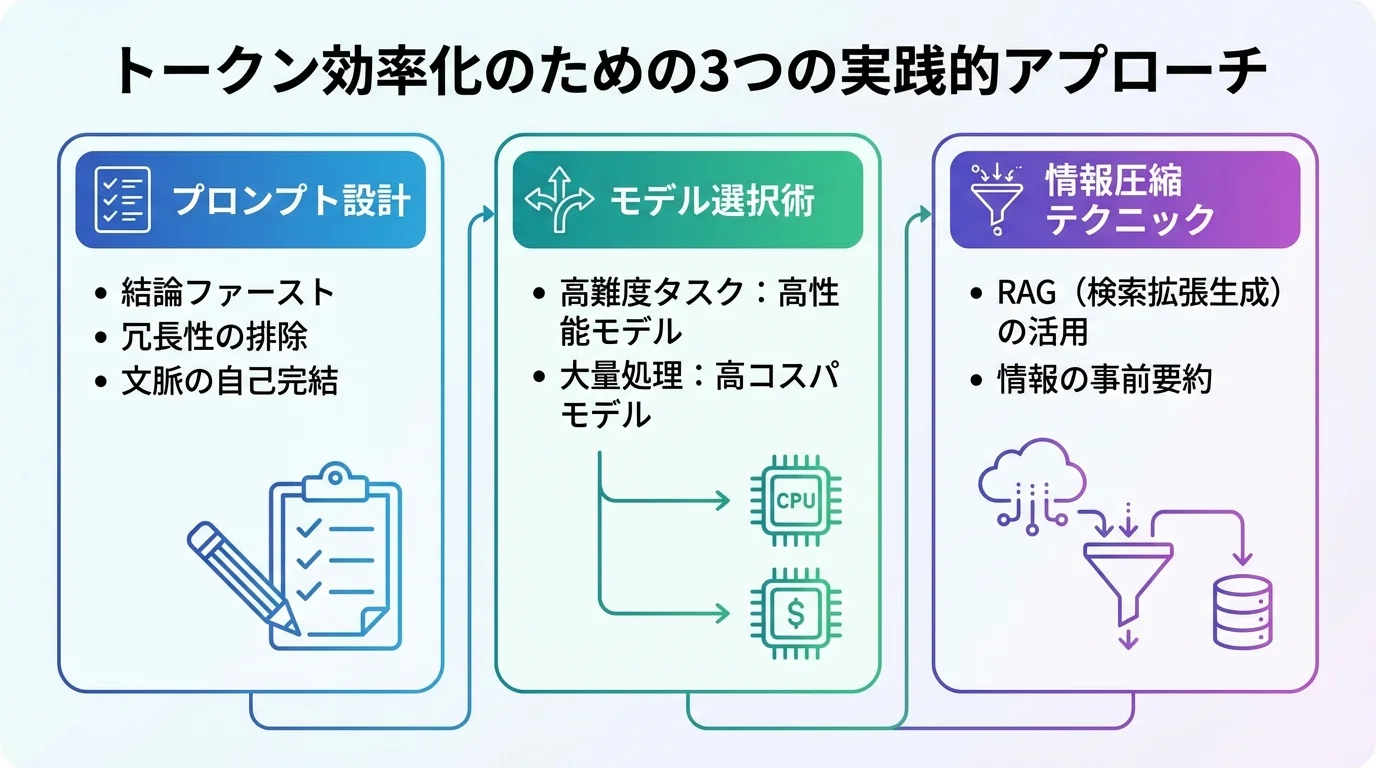

無駄なトークンを劇的に削減!プロンプト設計3つの鉄則

100万トークンという広大な処理能力は、無計画な利用によるコスト増大と隣り合わせです。特に自律的に思考を繰り返すAIエージェントは、裏側で膨大なトークンを消費します。この課題を克服し、AIの真価を引き出すためのプロンプト設計には、3つの鉄則が存在します。

第一に「結論ファースト」の徹底です。長大な文脈の中から重要情報を見落とす「大海の針」問題は、最新モデルでも依然として課題です。役割定義や最重要指示は必ずプロンプトの冒頭に記述し、AIの思考の軸を固定しましょう。

第二に「冗長性の排除」。特に日本語は英語に比べトークンを多く消費しがちです。曖昧な枕詞や丁寧すぎる表現はコストを増やすだけでなく、指示の核心をぼやかします。具体的かつ簡潔な言葉を選ぶことが、コストと精度の両方を改善します。

第三に「文脈の自己完結」。AIに不明な情報を推測させると、事実に基づかない情報を生成するハルシネーションを誘発します。必要な背景情報やデータはプロンプト内で明示的に提供することが重要であり、これは企業が生成AI導入で得られるメリットとは、精度の高いアウトプットを得るための基本でもあります。これらの鉄則が、新時代のAIを賢く使いこなす鍵となります。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

コストと性能を両立!用途に合わせたAIモデル選択術

100万トークン時代において、すべてのタスクに最高性能モデルを適用するのは賢明な策ではありません。真のトークン効率化は、用途に合わせたモデル選択から始まります。例えば、大学院レベルの複雑な推論が求められる研究分析にはGoogleのGemini 3.1 ProやAnthropicのClaude 4.6が最適ですが、そのトークン単価は高価です。一方で、チャットボットや定型的な要約といった大量処理が前提のタスクには、アリババの「千問(Qwen)3.5」のような、競合の数%という圧倒的な低コストで高性能を実現するモデルが最適解となり得ます。これからのAI活用は、単一の最強モデルに依存するのではなく、タスクに応じて最適なモデルを使い分ける「ポートフォリオ戦略」が不可欠です。この視点こそが、企業が生成AI導入で得られるメリットとはを最大化する鍵となるでしょう。

あわせて読みたい

生成AI 企業 導入 メリットについて、導入方法から活用事例まで詳しく解説します。

長文コンテキストを使いこなす!情報の要約と圧縮テクニック

100万トークンという広大なコンテキストウィンドウは、情報を無加工で投入するためのものではありません。長文をそのまま与えると、コストが増大するだけでなく、情報の重要度が薄まり、応答精度が低下する「コンテキストの腐敗」も懸念されます。真に長文を使いこなすには、戦略的な情報の「要約」と「圧縮」が不可欠です。

最も実践的な手法が、必要な情報だけを外部から検索して与えるRAG(検索拡張生成)の活用です。全文を読み込ませるのではなく、タスクに関連する部分だけを抽出することで、コストと精度を両立できます。また、長大なドキュメントは、一度AIに要約させてから本題のプロンプトに含める「二段階アプローチ」も有効です。これは、根本的なLLMとは何かという仕組みを理解し、ノイズを減らす工夫と言えるでしょう。最終的に、入力する情報の「質」をコントロールする意識こそが、トークン効率を最大化する鍵となります。

あわせて読みたい

LLM とは わかりやすくについて、導入方法から活用事例まで詳しく解説します。

「トークン量=知性」ではない?巨大化するコンテキストウィンドウの限界と注意点

100万トークンという圧倒的な記憶力を手に入れ、AIはもはや人間を超えたかのように見える。しかし、その性能向上を手放しで賞賛するのは早計だ。「記憶力=知性」という安直な等式は成り立たない。長大な情報の中から肝心な一点を見失う「大海の針」問題のように、巨大なコンテキストウィンドウは新たな欠陥とリスクを生み出している。ここでは、トークン量という指標の裏に潜むAIの限界を、敢えて辛口にえぐり出していく。

長大な文脈の罠、「中央の情報を忘れる」AIの欠陥

100万トークンという記憶力は、AIがすべてを完璧に記憶しているという幻想を生むが、現実は甘くない。長大な文章の「ど真ん中」に置かれた情報は、驚くほど簡単に見失われるのだ。これは「大海の針(Needle-in-a-Haystack)」問題として知られるAIの構造的欠陥であり、いくらコンテキストウィンドウが広がろうと解決されていない。情報の位置によって応答精度が大きく揺らぐようでは、真の読解力とは到底呼べない。結局、重要な情報は文頭か文末に配置するといった、まるで機械に忖度するような原始的な工夫が必要になる。AIの記憶が人間のそれとは似て非なる、脆いものである何よりの証左だ。

記憶量と思考力は別物?問われるAIの真の「知性」

100万トークンという膨大な記憶力は、AIが人間のように「思考」しているという幻想を加速させた。だが、これは根本的な誤解に他ならない。現在のAIの動作原理は、あくまで膨大なデータから次に来る確率が最も高い単語を予測する「高度なパターンマッチング」だ。因果関係や物理法則を真に理解しているわけではなく、その証拠に高度な論理的推論には依然として課題が残る。専門家が警鐘を鳴らす学習データの枯渇問題も目前であり、記憶容量の競争の先にあるのは、真の知性ではなく、現在のアーキテクチャの限界露呈かもしれない。

情報の洪水が引き起こす新たな「幻覚」のリスク

100万トークンという情報の洪水は、従来の「ハルシネーション」をより悪質で検知困難なものへと変質させている。問題は、AIが膨大な文脈の中から誤った情報や偏った意見を「根拠」として拾い上げ、他の正しい情報と巧妙に編み合わせることで、もっともらしく洗練された虚偽を構築してしまう点にある。これは単なる事実誤認ではない。複数の情報を統合する過程で論理そのものが歪む「コンテキストの腐敗」と呼ぶべき現象だ。結局、大量の情報を処理する能力は、それを批判的に吟味する能力とイコールではない。このままでは、AIは膨大な知識を持つ賢者ではなく、雄弁なだけのデマゴーグになりかねない危険な兆候だ。

まとめ:トークンを制する者がAIの未来を制す

生成AIの進化の鍵を握る「トークン」について、その本質から100万トークンが標準となる未来の展望までを解説してきました。AIが扱える情報量は飛躍的に増大していますが、重要なのは単なる量の増加ではなく、その「トークン効率」をいかに最大化するかという視点です。

AIエージェントが社会のあらゆる場面で活躍する未来は、もう目前に迫っています。あなたはこの技術的変革をどう捉え、ビジネスや日常に活かしていきますか?トークンの本質を理解し、コストと性能のバランスを取りながら賢く活用することこそが、これからの時代を勝ち抜くための羅針盤となるでしょう。

より実践的なAI活用戦略にご興味のある方は、ぜひOptiMaxにご相談ください。